プロンプトエンジニアリングとは?生成AIの精度を劇的に高める5つの実践アプローチ

タジケン

テクラル合同会社

生成AIの出力が一般的で実務に使えないという課題は、プロンプト(指示文)の設計を最適化することで解決できます。AIの能力を最大限に引き出し、期待通りの成果を得るための技術がプロンプトエンジニアリングです。本記事では、プロンプトエンジニアリングとは何かという基本から、AIの回答精度を劇的に高める5つの実践アプローチを解説します。

役割と背景(コンテキスト)の設定

プロンプトエンジニアリングとは、大規模言語モデル(LLM)から意図した高品質な出力を引き出すために、入力する指示文(プロンプト)を設計・最適化する技術です。生成AIの精度を劇的に高めるための第一歩として、まずは「AIに明確な役割と背景(コンテキスト)を与えること」が最重要のポイントとなります。

コンテキスト設定の基本とプロンプト事例

AIに対して単に「企画書を書いて」と指示するだけでは、一般的で抽象的な回答しか得られません。プロンプトエンジニアリングを実践する上で、まずは「誰が」「誰に向けて」「どのような目的で」出力するのかを定義することが、精度を左右する判断ポイントとなります。

AIに役割と背景を与えるだけで、回答の質は以下のように変わります。

【Before】(役割・背景なしのプロンプト) 新規事業のアイデアを3つ考えてください。

【After】(役割・背景を明確にしたプロンプト) あなたはBtoB SaaSビジネスに精通した経験豊富なプロダクトマネージャーです。 日本の中小企業が抱える「バックオフィス業務の非効率」を解決する新規事業のアイデアを3つ提案してください。 各アイデアには、ターゲット層、提供価値、マネタイズの基本方針を含めてください。

このように役割(ペルソナ)を与え、ターゲット層や市場の課題といった背景情報を詳細に記述することで、LLMは膨大な学習データの中から適切な文脈を選択し、専門的かつ実用的な回答を生成できるようになります。出力の質が低いと判断した場合は、このコンテキスト情報が不足していないかを見直すことが重要です。

現場で運用する際の注意点

ビジネスの現場でプロンプトエンジニアリングを運用する際、プロンプトの作成スキルが属人化しやすいという課題が発生します。特定の担当者だけが良いプロンプトを書ける状態を防ぐため、チーム内で効果のあったプロンプトをテンプレート化し、共有・改善していく仕組みが不可欠です。

また、AIの出力結果をそのまま実務に適用するのではなく、必ず専門知識を持つ人間がファクトチェックを行うプロセスを組み込む必要があります。とくに新規事業の立ち上げフェーズでは、AIによる壁打ちで仮説を構築しつつも、実際の顧客の声を拾い上げる検証サイクルが欠かせません。具体的な検証手法については、 MVP開発とは?新規事業の失敗リスクを下げるアジャイルな進め方と検証ポイント を参考にしてください。

ポイントの要点整理

ここまでの要点を整理すると、アプローチの第一歩は以下の3点に集約されます。

- 役割の明示: AIに専門家としてのペルソナを設定し、回答の解像度を上げる

- 背景の具体化: 目的、ターゲット、前提条件などのコンテキストを言語化して入力する

- チームでの標準化: 個人のスキルに依存せず、プロンプトをテンプレート化して運用する

これらの基本事項を押さえることで、AIの出力精度は飛躍的に安定し、プロダクト開発や業務効率化における強力な武器となります。

文脈と制約条件の明確化

生成AIから期待通りの結果を引き出すための第2のアプローチは、「文脈(コンテキスト)と制約条件の明確な提示」です。AIは人間のように行間を読んだり、暗黙の了解を察したりすることはできません。そのため、プロンプトエンジニアリングにおいては、前提となる状況やルールをいかに具体的に言語化するかが、出力精度を左右する重要な判断ポイントとなります。

文脈と制約条件を具体化する

AIにタスクを依頼する際は、単に「キャッチコピーを考えて」と指示するのではなく、「誰に向けて、どのような課題を解決するために、どの媒体で発信するのか」という背景情報を詳細に与える必要があります。これが文脈の提示という基本事項です。

さらに、出力結果に対する明確な制約条件を設けることも欠かせません。具体的には、以下のような項目をプロンプトに組み込みます。

- 文字数の指定(例:200文字以内、3箇条書きなど)

- トーン&マナー(例:専門用語を避けた平易な表現、丁寧な敬語など)

- 禁止事項(例:特定の競合他社名を出さない、ネガティブな表現を使わないなど)

これらの条件を事前に定義することで、意図しない回答による修正のやり取りを大幅に削減し、業務効率を飛躍的に向上させることができます。

現場で運用する際の注意点と要点

組織の現場でプロンプトエンジニアリングを運用する際、最も注意すべき点は属人化の防止です。特定の担当者だけが精度の高いプロンプトを書ける状態では、チーム全体の生産性は上がりません。成功したプロンプトはテンプレート化し、社内で共有する仕組みを構築することが重要です。

また、AIの出力結果は常に完璧とは限らないため、最終的には人間によるファクトチェックや品質確認のプロセスを業務フローに組み込む必要があります。特に、新しいビジネスモデルの構築や重要な意思決定にAIを活用する場合は、出力の妥当性を慎重に検証しなければなりません。事業開発の全体像や検証の進め方については、新規事業の立ち上げで失敗しない7つのプロセス|実践フレームワークと成功手法も合わせて参考にしてください。

このアプローチの要点を整理すると、AIに対する背景情報の共有と出力ルールの厳格化、そしてチームでの知見共有に集約されます。これらの要点を押さえることで、生成AIは単なるツールから、現場で信頼できる強力なアシスタントへと進化します。

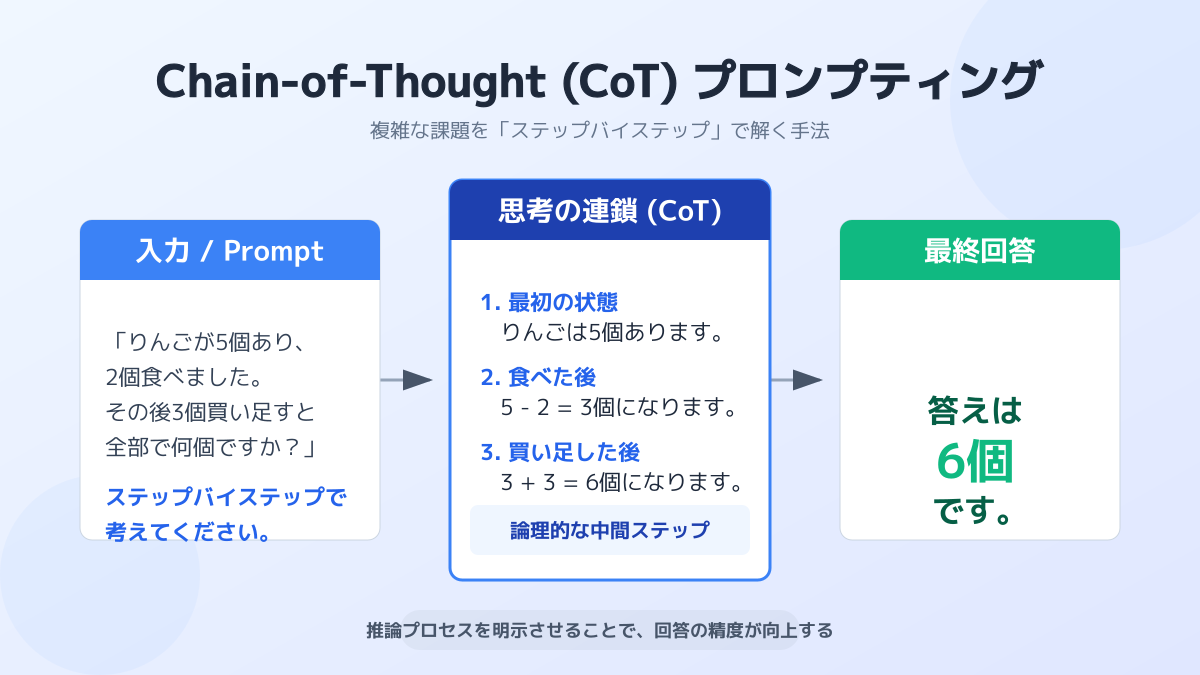

推論プロセスの明示(Chain-of-Thought)

プロンプトエンジニアリングにおいて、AIモデルに複雑な課題を正確に解かせるための強力なアプローチが「推論プロセスの明示」です。一般的にChain-of-Thought(思考の連鎖)と呼ばれるこの手法は、AIに最終的な答えだけを求めるのではなく、結論に至るまでの論理展開を段階的に出力させます。

単に「答えを教えてください」と指示するよりも、AIが情報を整理しながら処理を進めるため、計算問題や論理的推論を伴うタスクにおいて劇的な精度向上が期待できます。

推論プロセスを明示する基本事項

Chain-of-Thoughtの基本は、プロンプト内に「ステップごとに考えてください」という指示を追加すること、または推論の過程を含んだ具体例を提示することです。

大規模言語モデル(LLM)は、次に来る確率の高い単語を予測して文章を生成します。いきなり結論を出力させようとすると、複雑な条件を見落としやすくなります。推論プロセスを明示させることで、AI自身が直前に生成した論理的な文脈を踏まえて次のステップを予測できるようになり、出力の正確性が高まります。

手法を導入する際の判断ポイント

すべてのタスクにおいて推論プロセスを明示する必要はありません。プロンプトエンジニアリングを実践する上で、この手法を適用すべきかどうかの判断基準を持つことが重要です。

単語の翻訳といった単純な事実検索のタスクでは、推論のステップを踏ませるメリットはなく、かえって冗長な回答を招きます。一方で、複数の条件が絡む業務マニュアルの解釈やデータ分析など、多段的な論理展開が必要なタスクにおいては、この手法が不可欠です。

タスクの難易度を評価し、AIが論理の飛躍や計算ミスを起こしている場合にのみ、推論プロセスを明示するアプローチを採用するのが適切な判断ポイントとなります。

現場で運用する際の注意点

実際のビジネス現場でこの手法を運用する際には、いくつかの注意点があります。

第一に、出力されるテキスト量(トークン数)が増加する点です。AIの利用料金は処理したトークン数に比例して課金されることが多いため、システムに組み込む場合は、コストの増加と処理速度の低下を考慮した設計が求められます。

第二に、AIが途中の推論ステップで間違った前提を置いてしまうと、最終的な結論も大きくずれるリスクがあります。これを防ぐには、プロンプト内に正しい推論の具体例をあらかじめ提示し、AIに望ましい思考の型を学習させることが有効です。

複雑な課題に対してはステップごとに考えるよう指示することで、AIの論理的な処理能力を引き出せます。適用する際はタスクの複雑さを見極め、単純な事実確認には使わず、多段的な推論が必要な場面に限定することが成功の鍵です。

高度な推論手法の活用

生成AIから精度の高い回答を引き出すための第4のポイントは、高度な推論手法を活用することです。具体例の提示と思考プロセスの誘導を組み合わせることで、単純な指示だけでは解決できない複雑なタスクに対応できます。

Few-Shotプロンプティングの基本

代表的な手法として、入力と出力の例をいくつか提示する「Few-Shotプロンプティング」があります。前述の「Chain of Thought(思考の連鎖)」と組み合わせることで効果が倍増します。たとえば、独自のフォーマットでデータを出力させたい場合、事前に2〜3個の正解例をプロンプト内に含めるだけで、AIは文脈を正確に理解し、期待通りの形式で回答を生成します。

導入すべきタスクの判断ポイント

これらの手法を導入すべきかどうかの判断ポイントは、タスクの複雑性と論理的飛躍の有無にあります。一般的な文章の要約や翻訳であれば、事前の例示がない単純な指示(Zero-Shot)で十分です。しかし、数学的な計算、複雑な条件分岐を伴う論理推論、あるいは社内特有のルールに基づくデータ処理などを行う場合は、推論プロセスを明示的にガイドする設計手法が不可欠です。

現場で運用する際の注意点

現場でこれらの手法を運用する際は、トークン消費量と例示の品質に注意する必要があります。具体例を多く含めると、その分入力トークン数が増加し、APIの利用コストや処理時間の増大を招きます。また、提示した例に偏りや誤りがあると、AIがそれを学習してしまい、かえって事実に基づかないもっともらしい嘘(ハルシネーション)を引き起こす原因となります。質の高い例を厳選し、最小限の数で最大の効果を狙う設計が求められます。

体系的なスキルの習得

AIに対して何をすべきかだけでなく、どのように考えるべきかを具体的に示すことが重要です。こうした高度なプロンプト設計のスキルは、経験則だけでなく体系的に学ぶことが推奨されます。

近年では、プロンプトエンジニアリング関連の資格を取得することを通じて、AIの挙動やモデルの特性、セキュリティに関する知識を網羅的に身につけるエンジニアやビジネス担当者も増えています。現場での実践と体系的な学習を組み合わせることで、AI活用プロジェクトの成功率は飛躍的に高まります。

継続的な評価と改善の仕組み

プロンプトエンジニアリングにおける5つ目の重要なアプローチは、出力結果に対する継続的な評価と改善(イテレーション)の仕組みを構築することです。一度作成したプロンプトが常に最適な結果を返し続けるとは限りません。そのため、システムや業務に組み込んだ後も、定期的に品質を検証するプロセスが不可欠です。

評価基準と判断ポイントの具体化

プロンプトを改善する際は、出力の良し悪しを客観的に測る基準が必要です。具体的には、事実に基づく正確性、複数回の実行における一貫性、および指定したフォーマットの遵守率の3点を評価軸として設定します。これらの基準を満たしていない場合、プロンプト内の指示が曖昧であるか、制約条件が不足していると判断し、文言の微調整を行います。

現場で運用する際の注意点

実際の業務現場でプロンプトエンジニアリングを運用する際の最大の注意点は、大規模言語モデル(LLM)自体のバージョンアップや、入力されるユーザーデータの傾向変化によって、予期せず出力の質が低下するリスクがあることです。この課題に対応するためには、あらかじめ複数のテストケース(正解データ)を用意し、定期的にテストを実行する監視体制を整える必要があります。

結果として、プロンプトの作成は一度きりの作業ではなく、運用しながら継続的にチューニングを行うサイクルそのものです。現場のフィードバックを迅速にプロンプトへ反映させる運用フローを構築することで、AIの回答精度を長期的に高く保つことが可能になります。

まとめ

プロンプトエンジニアリングは、生成AIの可能性を最大限に引き出し、ビジネスにおける具体的な課題解決に直結するための不可欠な技術です。本記事では、AIに明確な役割とコンテキストを与えることから始まり、文脈と制約の提示、推論プロセスの明示、Few-Shotプロンプティングなどの高度な手法、そして継続的な評価と改善の5つのアプローチを紹介しました。

これらの実践手法を組織的に導入し、継続的に磨き上げることで、AIの出力精度は安定し、生成AIは単なるツールを超え、企業の競争力を高める強力な武器となるでしょう。

この記事を書いた人

タジケン

テクラル合同会社

一部上場企業を経て広告代理店に入社し、デジタルマーケティングの知見を深める。現在はテクラルにて、数千万規模の大型案件でプロジェクトリードを担当。KPI設計や広告運用などのマーケティング領域から、AIを活用したシステム開発の導入支援までプロダクトの成長を一気通貫でサポートしている。本ブログでは、事業フェーズに合わせた実践的なノウハウをお届けする。