【2026年最新】生成AI著作権ガイドライン|企業が今すぐ実践すべき対策と侵害リスク回避の手順

タジケン

テクラル合同会社

生成AIの著作権侵害リスクは、学習段階と利用段階で異なる法的判断基準を理解し、社内ガイドラインの策定とAIプロバイダーの補償制度活用を組み合わせることで、大幅に回避可能です。本記事では、文化庁「AIと著作権に関する考え方」(2024年3月公表)に基づく類似性・依拠性の判断基準から、現場での具体的な運用ルールまで、企業が安全にAIを導入するための実践的アプローチを解説します。

生成AIにおける著作権侵害の基本構造

企業が業務でAIを活用する際、まず理解すべきなのは、どのプロセスで権利侵害のリスクが発生するのかという基本構造です。

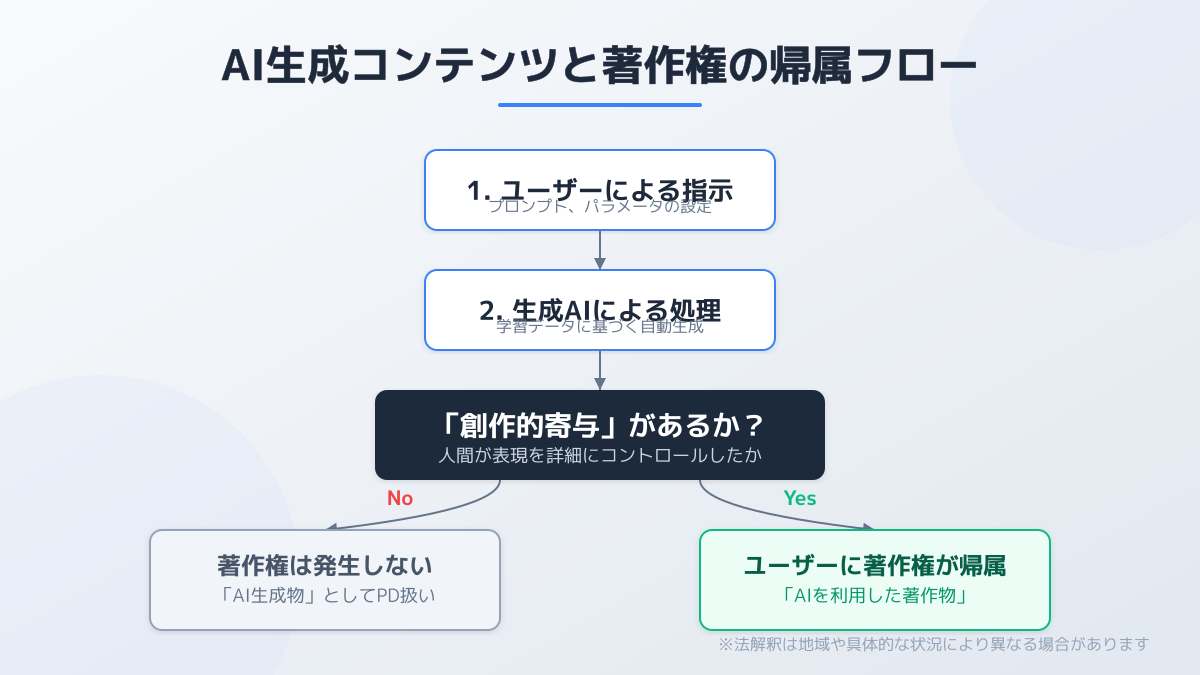

生成AIの著作権問題は、大きく「開発・学習段階」と「生成・利用段階」の2つに分けて考える必要があります。

AIモデルを構築するための「学習段階」では、日本の著作権法第30条の4により、原則として著作権者の許諾なくデータを学習させることが認められています。しかし、ユーザーがプロンプトを入力してコンテンツを出力する「生成・利用段階」においては、通常の著作権法が適用されます。

つまり、生成された画像や文章が既存の著作物と類似しており、それを公開したり商用利用したりした場合、生成AIによる著作権侵害に問われるリスクが生じます。社内で生成AIを利用する際は、この「出力された結果の利用」が法的な責任を伴う行為であることを、経営層から現場の担当者まで全員が認識しなければなりません。

著作権侵害の判断基準

生成・利用段階において、著作権侵害が成立するかどうかは、主に「類似性」と「依拠性」の2つの要件で判断されます。これは従来の著作権法における侵害判断の基本原則と同じです。

第一に、類似性とは、AIが生成したコンテンツが既存の著作物と同一、あるいは極めて似ていることを指します。構図、色彩、文章の表現など、元の著作物の本質的な特徴が直接的に感じ取れる場合、類似性が認められます。

第二に、依拠性とは、既存の著作物を認識し、それを元にして創作したという事実です。生成AIの場合、学習データとしてその著作物が含まれていたか、あるいはユーザーがプロンプトとして既存の著作物を入力したかどうかが焦点となります。

もし、AIの出力結果が既存の著作物と酷似しており、かつそのAIが当該著作物を学習していたことが証明された場合、生成AIによる著作権侵害が成立する可能性が極めて高くなります。したがって、企業は「AIが作ったから安全」という認識を改め、出力結果に対する厳密なチェック体制を構築する必要があります。

現場で運用する際の注意点

生成AIを現場で安全に運用するためには、システム任せにせず、人間の目による確認プロセスを組み込むことが重要です。具体的な注意点として、以下のプロセスを徹底してください。

まず、プロンプト(指示文)の入力段階での制限です。他者の著作物、例えば既存のキャラクター名、特定の作家の画風、あるいはニュース記事の本文などをそのままプロンプトに入力する行為は、依拠性を自ら作り出すことになり、著作権侵害のリスクを跳ね上げます。

なお、近年はChatGPT画像生成の商用利用ガイドラインやAIエージェントの社内ルール策定において、各ツールの利用規約確認が必須となっています。生成AIを新規事業やプロダクト開発に活用する場合、事業のコアとなる部分でAI出力物をそのまま用いると、後々大きな法的リスクを抱える可能性があるため、厳格なルール運用が求められます。

次に、出力結果の検証です。AIが生成した成果物をそのまま外部へ公開するのではなく、既存のコンテンツと類似していないかを逆画像検索やテキストのコピペチェックツールを用いて確認します。特に、マーケティング素材やWebサイトのコンテンツなど、外部の目に触れる商用利用の場面では、この検証プロセスを省いてはなりません。

社内ガイドラインの策定ポイント

企業が生成AIを業務に導入する際、法的リスクをコントロールするための社内ルールの整備は不可欠です。全社統一の生成AIに関する著作権ガイドラインを策定することが第一歩となります。

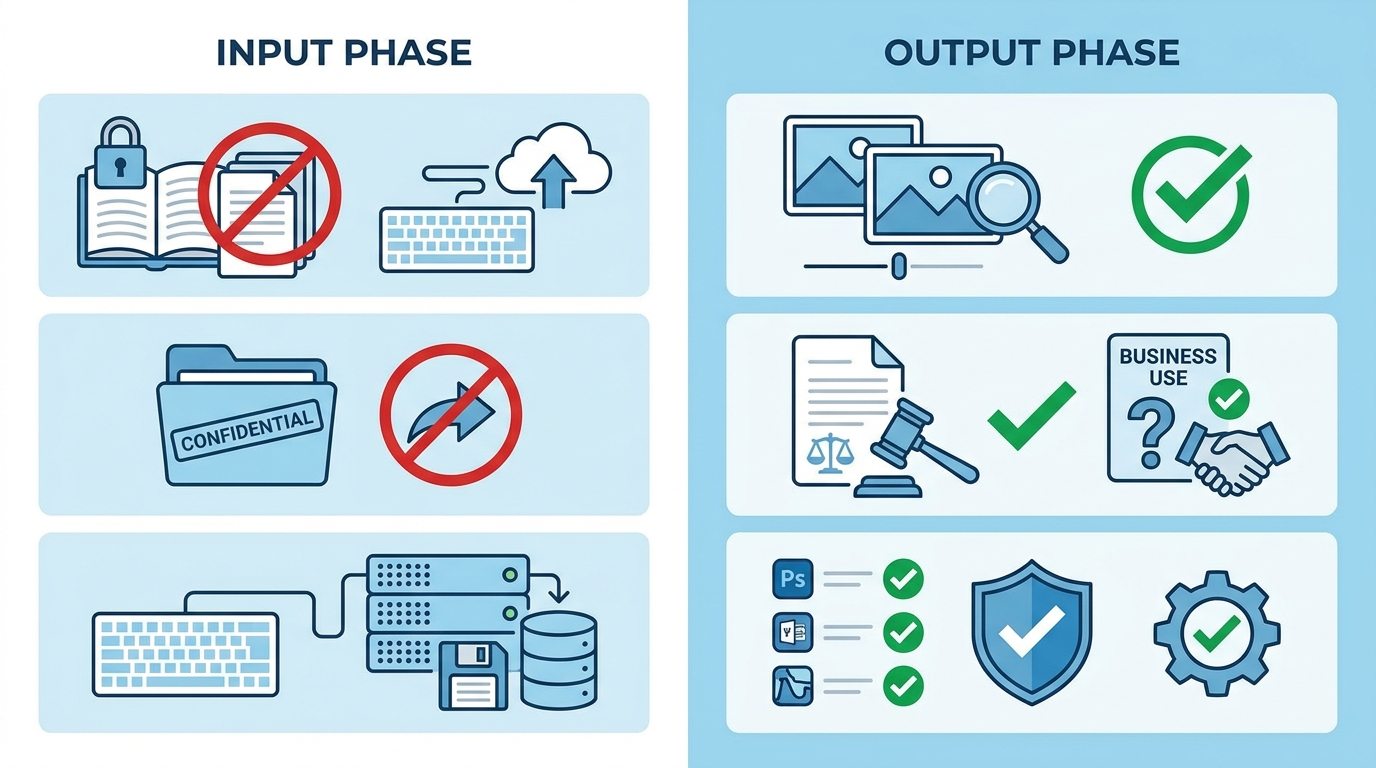

ガイドラインに盛り込むべき基本事項は、入力(プロンプト)と出力(生成物)の2つのフェーズに大別されます。入力フェーズでは、他社の著作物や機密情報をプロンプトとして送信しないことを明確に規定します。出力フェーズでは、生成されたテキストや画像が既存の著作物と類似していないかを確認するプロセスを義務付けます。

また、利用するAIツールごとの利用規約の確認も必須です。商用利用が許可されているか、生成物の著作権が誰に帰属するのかをツールごとにリスト化します。社内で利用可能なツールをホワイトリスト形式で指定することで、現場の担当者が迷うことなく安全なツールを選択できる環境を構築できます。

文化庁は2024年3月に「AIと著作権に関する考え方について」を公表し、AI開発者・サービス提供者・利用者それぞれの責任範囲を明確化しました。企業のガイドライン策定では、この見解を参照しながら「自社の利用が著作権法第30条の4の範囲内か」を法務部門と連携して確認することを強く推奨します。

プラットフォーマーの補償制度の活用

企業が安全にAIを活用するためのもう一つの観点は、プラットフォーマーが提供する補償制度の把握です。ツールを提供する企業のサポート体制を理解することが、リスクマネジメントの鍵となります。

近年、生成AIの著作権問題に対する企業の関心が高まる中、大手テクノロジー企業はユーザーを保護するための制度を整備し始めています。たとえば、MicrosoftのCopilot Copyright Commitmentは、生成AIの著作権問題における大規模企業の取り組みの代表例です(出典:AIと著作権に関するチェックリスト&ガイダンス)。

この制度では、顧客が指定された安全装置やガイドラインを遵守してサービスを使用している限り、万が一著作権侵害で訴えられた場合でも、Microsoftが法的責任を引き受け、関連する費用を補償するとしています。こうした補償制度の有無や適用条件を事前に確認することは、企業が安全にAIツールを選定するための重要な指標となります。

まとめ

生成AIの業務活用において、著作権侵害のリスク管理は企業の喫緊の課題です。本記事では、このリスクを回避し、安全にAIを導入するための重要なポイントを解説しました。

主な要点は以下の通りです。

- 法的理解と段階別のリスク把握: AIの学習・生成段階で異なる法的解釈を理解し、リスクを正確に把握すること。

- 侵害判断基準と社内チェック: 「類似性」と「依拠性」に基づき、プロンプト入力や出力結果の確認体制を構築すること。

- 社内ガイドラインの策定: 入力データ制限、出力物検証義務、ホワイトリストツール管理などのルールを明確化すること。

- プロバイダーの補償制度活用: AIプロバイダーの補償制度や利用規約を確認し、外部の守りを活用すること。

- 文化庁ガイドラインの参照: 2024年3月公表の「AIと著作権に関する考え方について」を法務部門と連携して定期的に見直すこと。

これらの対策を講じることで、企業は法的リスクを最小限に抑えつつ、生成AIがもたらす業務効率化の恩恵を最大限に享受できます。

この記事を書いた人

タジケン

テクラル合同会社

一部上場企業を経て広告代理店に入社し、デジタルマーケティングの知見を深める。現在はテクラルにて、数千万規模の大型案件でプロジェクトリードを担当。KPI設計や広告運用などのマーケティング領域から、AIを活用したシステム開発の導入支援までプロダクトの成長を一気通貫でサポートしている。本ブログでは、事業フェーズに合わせた実践的なノウハウをお届けする。